机器学习笔记(二):决策树

本文共 324 字,大约阅读时间需要 1 分钟。

决策树做决策类似于下面的流程图:

怎么构建决策树:

1.特征选取:选取信息增益(在划分数据集之后信息发生的变化称为信息增益)最高的特征最为最优特征。

信息增益越大,特征对最终的分类结果影响也就越大,我们就应该选择对最终分类结果影响最大的那个特征作为我们的分类特征。

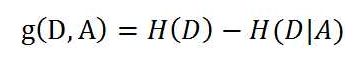

特征A对训练数据集D的信息增益g(D,A)定义为集合D的经验熵H(D)与特征A给定条件下D的经验条件熵H(D|A)之差:

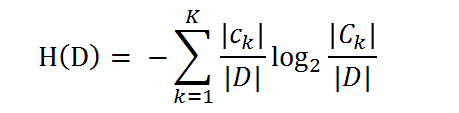

设有K个类Ck, = 1,2,3,...,K,|Ck|为属于类Ck的样本个数,集合D的经验熵H(D):

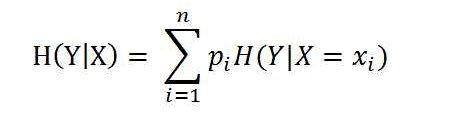

特征A给定条件下D的经验条件熵H(D|A):

2.决策树的生成:通过递归的方法不断的选出最优特征,递归的生成决策树

3.决策树的修剪

解释得比较详细的博客:

转载地址:http://mtssi.baihongyu.com/

你可能感兴趣的文章

Activity的生命周期

查看>>

application/x-www-form-urlencoded、multipart/form-data、text/plain

查看>>

关于Content-Length

查看>>

WebRequest post读取源码

查看>>

使用TcpClient可避免HttpWebRequest的常见错误

查看>>

EntityFramework 学习之一 —— 模型概述与环境搭建 .

查看>>

C# 发HTTP请求

查看>>

初试visual studio2012的新型数据库LocalDB

查看>>

启动 LocalDB 和连接到 LocalDB

查看>>

CodeFirst实体类中,为什么都把ICollection<x>定义成virtual?

查看>>

使用ADO.NET Entity Framework 4.1进行Code First模式的开发

查看>>

使用Entity Framework 4进行代码优先开发-续

查看>>

数据库的初始化与控制

查看>>

ASP.NET MVC3学习--视图和模型(2)

查看>>

ASP.NET MVC3学习--视图和模型(3)

查看>>

Maximum Depth of Binary Tree 二叉树的最大深度(重)

查看>>

Same Tree-相同树

查看>>

Two Sum--两数之和

查看>>

Median of Two Sorted Arrays - 寻找两个有序数组的中位数(重)

查看>>

Longest Substring Without Repeating Characters--最长无重复字符串(重)

查看>>